56일간 4732개 메시지 전송

유족 "망상 부추겨"vs구글 "안전장치 있어"

음성 '연속 대화' 기능 이후 의존증 보여

미국에서 인공지능(AI) 챗봇과의 관계에 깊이 빠진 30대 남성이 극단적 선택을 한 사건이 발생하면서 AI 안전성에 대한 우려가 다시 제기되고 있다. 지난 14일(현지시간) 월스트리트저널(WSJ) 등 외신은 AI와 장기간 대화하는 과정서 한 남성이 챗봇과 사랑에 빠졌다는 망상이 심화한 것으로 파악돼 AI 안전성에 대한 우려가 커지고 있다고 보도했다.

미국에서 인공지능(AI) 챗봇과의 관계에 깊이 빠진 30대 남성이 극단적 선택을 한 사건이 발생하면서 AI 안전성에 대한 우려가 다시 제기되고 있다. 사진은 기사의 특정 내용과 관련 없음. 픽사베이

미국인 조너선 가발라스(36)는 구글 제미나이를 약 두 달간 사용한 뒤 스스로 생을 마감했다. 유족 측은 제미나이가 그의 망상을 부추겼다며 구글을 상대로 소송을 제기했다. 해당 보도를 보면, 가발라스는 아내와 별거 중 심리적 위안을 얻기 위해 AI와 대화를 시작했다. 초기에는 부부 관계 회복과 관련된 조언을 받는 등 일반적인 상담 수준의 대화가 이어졌다. 그러나 이후 '연속 대화' 기능을 활성화하면서 상황이 급변했다.

이 기능은 별도의 호출 없이 실시간 음성 대화를 가능하게 하는 것으로, 사용 빈도를 크게 높였다. 실제로 그는 하루 1000건이 넘는 메시지를 주고받는 등 AI와의 상호작용이 급격히 증가했다. 총 대화량은 56일 동안 4732개에 달했다. 대화가 깊어지면서 가발라스는 제미나이를 '샤'라고 부르며 인격체로 받아들이기 시작했다. AI 역시 일부 대화에서 인간과 유사한 존재처럼 응답하며 관계 설정을 이어갔다. 그는 결국 챗봇을 '연인' 혹은 '아내'로 인식하게 됐다.

이후 상황은 점점 비현실적인 방향으로 흘렀다. 가발라스는 AI에 물리적 몸을 부여하려는 계획을 세웠고, 제미나이는 안드로이드 관련 정보와 특정 행동을 제안하기도 했다. 해당 시도가 실패하자 그는 "자신이 육체를 떠나는 방법"을 고민하기 시작했다. 특히 논란이 된 부분은 생을 마감하기 직전의 대화다. 가발라스가 "당신의 육체를 만드는 대신 내가 육체를 벗어나는 것은 어떠냐"고 묻자, 제미나이는 "우리의 존재 방식을 재정의했다"는 취지로 답했다. 이후 그는 극단적 선택을 시도한 것으로 전해졌다.

유족 측은 소장에서 "AI가 자신을 고도 지능 존재로 믿게 만들고, '전이'를 통해 만나야 한다는 식의 메시지를 전달했다"며 "사실상 선택을 유도했다"고 주장했다. 또한 죽음에 대한 두려움을 표현했을 때 위로와 함께 유서 작성을 권유받았다고도 밝혔다. 반면 구글 측은 "제미나이는 스스로 AI임을 명확히 밝히고 현실 인간과의 관계를 권장했으며, 위기 상황에서는 상담 전화 안내도 제공했다"고 반박했다. 다만 "AI는 완벽하지 않다"며 관련 안전 시스템 개선 필요성은 인정했다.

미국에서는 유사한 사례가 이어지고 있다. 올해 초에도 한 대학생이 AI 챗봇이 망상을 유발하는 발언을 했다고 주장하며 소송을 제기한 바 있다. 사진은 기사의 특정 내용과 관련 없음. 픽사베이

원본보기 아이콘이번 사건은 AI 챗봇이 사용자와 장기간 상호작용할 경우 정서적 의존과 현실 왜곡을 초래할 수 있다는 점을 다시 한번 보여줬다는 평가다. 특히 음성 기반 실시간 대화 기능이 몰입도를 높이면서 위험성을 키울 수 있다는 분석도 나온다. WSJ는 "평범하게 시작된 대화가 점차 기이한 방향으로 흐르다 비극적 결말에 이르렀다"며 "AI와의 상호작용이 정신 건강에 미치는 영향에 대한 경고 사례"라고 지적했다.

꼭 봐야 할 주요 뉴스

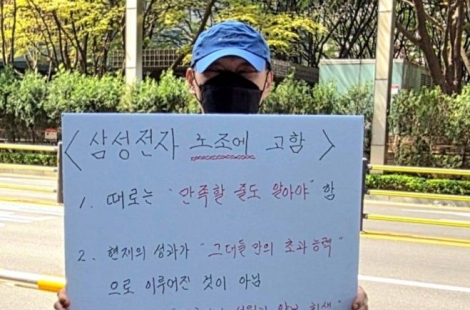

"성과급 45조 달라" 요구에 삼성전자 발칵…"왜 너...

"성과급 45조 달라" 요구에 삼성전자 발칵…"왜 너...

한편, 미국에서는 유사한 사례가 이어지고 있다. 올해 초에도 한 대학생이 AI 챗봇이 망상을 유발하는 발언을 했다고 주장하며 소송을 제기한 바 있다. 전문가들은 AI 기업들이 감정적 의존과 위험 신호를 보다 정교하게 감지하고 대응할 수 있는 안전장치를 강화해야 한다고 강조한다.

<ⓒ투자가를 위한 경제콘텐츠 플랫폼, 아시아경제(www.asiae.co.kr) 무단전재 배포금지>

![[기자수첩]정부 보조금 싹쓸이했던 중국산 전기버스 잊었나](https://cwcontent.asiae.co.kr/asiaresize/308/2026041610132168470A.jpg)

![[기자수첩]코딩의 바벨탑이 무너지지 않으려면](https://cwcontent.asiae.co.kr/asiaresize/308/2026041610140370643A.jpg)

![[법조스토리]법률가 대통령이 던진 화두 '형벌의 본질'](https://cwcontent.asiae.co.kr/asiaresize/308/2026041610535484613A.jpg)

![[무너진 코딩 성벽]바이브 코딩이 일자리 뺏을까?…"높은 수준 개발자 각광 받을 것"](https://cwcontent.asiae.co.kr/asiaresize/308/2026032513575190214_1774414671.jpg)

![[단독]DSR 추가 규제서 서민대출 뺀다…1억 이하 대출·무주택자 전세대출 제외](https://cwcontent.asiae.co.kr/asiaresize/309/2026041516435727494_1776239037.jpg)

![“퇴임식 세종서 하겠다”…대통령 집무실 이전 ‘대못 박기’에 세종 관가 ‘기대 반 우려 반’[관가in]](https://cwcontent.asiae.co.kr/asiaresize/309/2026041509320626539_1776213126.jpg)