"일주일 후 다시 오세요" 카메라로 '찰칵' 찍으니 벚꽃 만개 시기까지 '척척' [AI 비서 시대]③

진화한 AI 비서 구글 서치라이브

카메라로 찍고 음성으로 물어보면 대답 '척척'

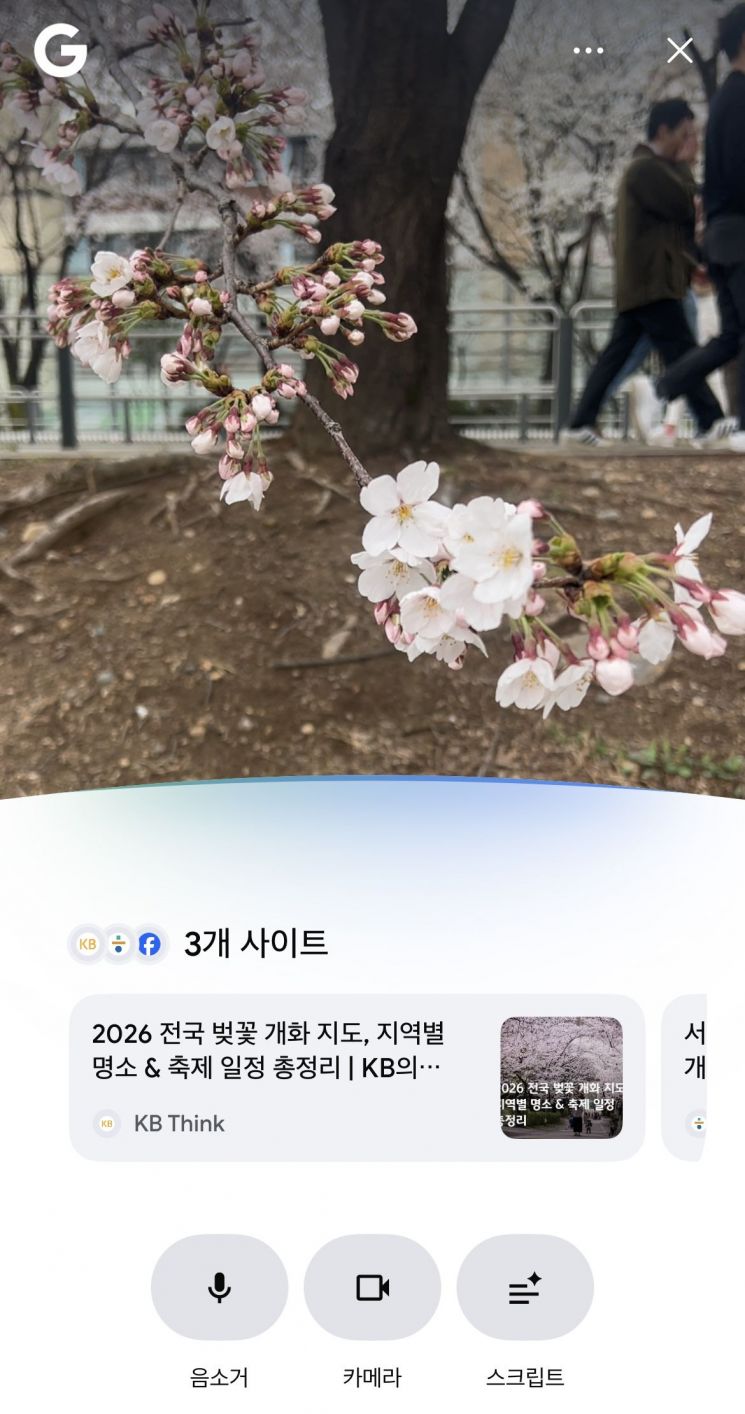

"이제 막 꽃망울이 터지기 시작한 개화 초기 단계입니다. 나무에 분홍색 봉오리들이 많이 맺혀있는 상태로, 개화 후 일주일 정도면 활짝 피기 때문에, 4월7~12일 사이에 여의도에 방문하면 화려하게 만개한 상태를 볼 수 있어요."

2일 오후 벚꽃이 피기 시작한 서울 영등포구 여의도한강공원 앞에서 구글을 켰다. 휴대폰 후면 카메라로 벚나무를 찍은 뒤 꽃이 어느 정도 피었는지, 언제쯤 다시 와야 꽃구경을 제대로 즐길 수 있는지를 물었다. 근처에 있던 산수유와 비교해 얼마나 늦게 필지도 척척 대답해줬다. 휴대폰으로 검색을 한다기보다 얼굴 없는 똑똑한 비서가 옆에서 궁금한 것을 다 알려주고 있는 기분이었다.

구글은 지난달 27일 한국에서 서치라이브를 출시했다. 음성과 카메라를 교차로 활용하며 실시간 양방향 대화가 가능한 검색 기능이다. 지난해 미국에서 처음 선보인 후 이번에 한국으로 서비스를 확대했다. 구글은 2024년 생성형 AI를 활용해 검색 결과의 핵심 정보를 요약해주는 'AI 개요'를 출시했고, 지난해에는 추론 및 멀티모달 기능을 강화한 'AI 모드'를 지원했는데 이번에는 사용자와 같은 장소에 있는 비서처럼 상황을 인식해 답을 해줄 수 있는 서비스를 내놓은 것이다.

변화의 중심에는 텍스트를 넘어 영상, 음성 등 비정형 데이터를 활용해 복잡한 검색도 가능하게 해주는 멀티모달 기능이 자리하고 있다. 이번 서치라이브의 핵심은 '상황 기반의 대화'가 음성과 카메라 인식으로 확장됐다는 점이다. 사용자는 키워드를 검색창에 입력해 정보를 찾아야 했던 과거와 달리 상황에 맞는 정보만 문답식으로 받을 수 있다.

손으로 검색어를 입력하지 않고도 대화하듯 물어볼 수 있어 이동 중에도 이용이 편리하다는 점은 서치라이브의 강점이다. 사용자는 답변의 기반이 되는 링크를 클릭해 심층적인 정보를 확인할 수 있다. 감정적 맥락에 기반한 질문도 가능했다. 일례로 '고양이는 돈을 내는 것도 아닌데 당당하게 걸어 다니는 이유가 뭐야' '오늘 낮 날씨에 어울리는 힙합 음악을 추천해달라' 등을 물어볼 수 있었다. 말이나 텍스트로 설명하기 어려운 상황에서 카메라를 켜면 서치라이브는 시각적 맥락을 바탕으로 질문에 대답한다.

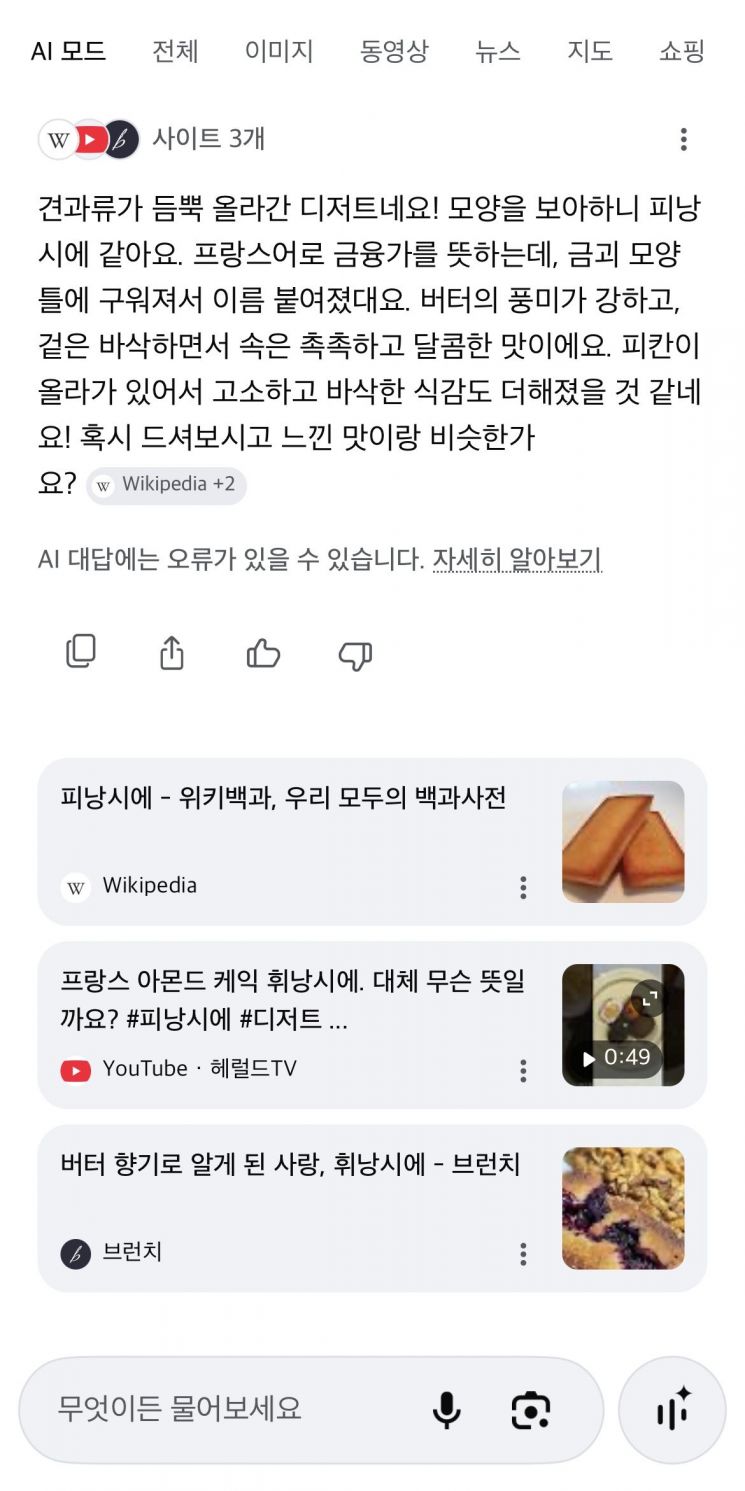

검색의 품질도 높아졌다. 실시간 영상에 음성을 더해 질문할 수 있어 사용자가 원하는 맥락을 자세하게 전달할 수 있어서다. 단일 정보를 넘어 종합적인 인사이트를 제공해준다는 느낌을 받았다. 실제로 피칸 피낭시에를 카메라로 찍으니 "피칸이 듬뿍 올라간 디저트로, 달콤한 맛에 피칸이 올라가 고소한 식감도 더해졌을 것"이라며 "'피낭시에'는 프랑스어로 금융가를 뜻하는데, 금괴 모양 틀에 구워져서 이름 붙여졌다"고 설명했다. 그 외에도 집에 있는 식물의 유래, 생육 환경, 건강 상태 등을 묻거나, 1인 가구라는 상황과 선호 브랜드에 맞춰 제품을 찾아줬다.

최신 정보엔 접근 어려워…2023~2024년까지가 '최신'

다만 모든 검색 결과가 최신 정보나 정확한 연구, 보도에 기반한 것은 아니었다. 답변에 덧붙여진 출처를 확인하면 주로 나무위키, 페이스북, 티스토리 등이었고, 2023~2024년의 정보가 공유됐다. 위치에 기반한 질문에는 부정확한 답을 하기도 했다. 가령 서울 중구 시청 인근에 서서 '여기서 광화문역까지 걸어서 얼마나 걸리냐'라고 물었지만, 출발점을 충남 공주시로 설정해 당황스러웠다. 10분 거리의 마트까지 걸어서 얼마냐 걸리냐고 물으니, 2~3분 이내에 도착이 가능하다고 답하기도 했다.

꼭 봐야 할 주요 뉴스

"지금이 매수 타이밍이라더니"…2029년 '대폭락' ...

"지금이 매수 타이밍이라더니"…2029년 '대폭락' ...

음성으로 제공된 검색 결과를 스크립트로 확인하기도 어려웠다. 대화가 끝난 후 내용을 텍스트로 확인하고 싶었지만, 일부 내용이 '문제가 발생해 AI 대답을 생성할 수 없다'고 떠 추가 정보에 접근할 수 없었다.

<ⓒ투자가를 위한 경제콘텐츠 플랫폼, 아시아경제(www.asiae.co.kr) 무단전재 배포금지>

![[럭셔리월드]"임신부터 예약 전쟁"…1200만원 돌잔치 '팔선고시'](https://cwcontent.asiae.co.kr/asiaresize/308/2025071508521145584_1752537130.jpg)

![[초동시각]"많이 오지만 적게 쓴다" 한국 관광의 딜레마](https://cwcontent.asiae.co.kr/asiaresize/308/2026040309512226534A.jpg)

![[리셋정치]대구는 전에 없던 선택을 할 것인가](https://cwcontent.asiae.co.kr/asiaresize/308/2026040307450948181A.jpg)

![[기자수첩]혁신 막는 벤처투자촉진법의 역설](https://cwcontent.asiae.co.kr/asiaresize/308/2026040519213535688A.jpg)

!["수요 폭증하는데 물량이 없어요"…판 커지자 韓부품사들 날개 달았다[칩톡]](https://cwcontent.asiae.co.kr/asiaresize/309/2026040311254913103_1775183149.jpg)

!["인터넷 끊겼어?" 스마트폰, 노트북 다 먹통…순식간에 70년대로 돌아간 모스크바[시사쇼]](https://cwcontent.asiae.co.kr/asiaresize/309/2026040512061714208_1775358377.jpg)

![벚꽃놀이가 아니라 벚꽃전쟁…양복 입고 회사 대신 공원으로 출근한 직장인들[日요일日문화]](https://cwcontent.asiae.co.kr/asiaresize/309/2026040115333599822_1775025215.png)

!["삼성이 먼저 치고 나간다"…독주 균열 조짐에 긴장한 대만 [대만칩통신]](https://cwcontent.asiae.co.kr/asiaresize/309/2026021016165236782_1770707812.jpg)

![고물가에 눌린 서민들 위안…폴란드엔 '우유 식당' 있다 [맛있는 이야기]](https://cwcontent.asiae.co.kr/asiaresize/309/2026040114153699575_1775020536.jpg)

!["임신부터 예약 전쟁"…1200만원 돌잔치 '팔선고시'[럭셔리월드]](https://cwcontent.asiae.co.kr/asiaresize/309/2026040314423013335_1775194949.jpg)