"연봉 6억에 모셔요" 무기 전문가 뽑는 빅테크…AI 윤리 방어선 구축

앤스로픽·오픈AI·MS·구글·메타 등

전쟁에 동원된 AI 기술

최소 안전판 마련 위해 무기 전문가 채용

미국 빅테크들이 무기·생화학 전문가 모시기에 나섰다. 인공지능(AI) 모델이 위험한 화학 정보를 생성하지 못하게 가이드라인을 설계하는 등 윤리적 방어선을 구축하기 위함이다.

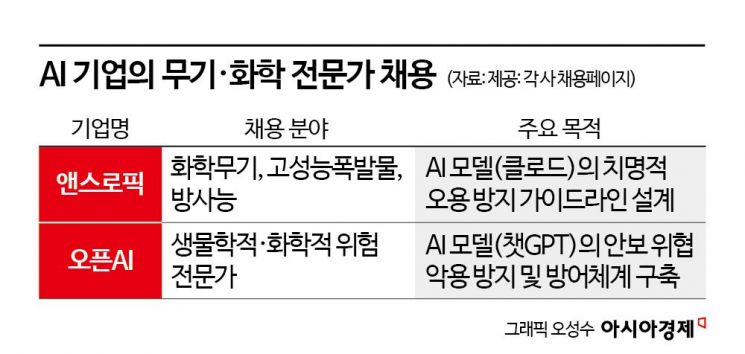

25일 정보기술(IT) 업계에 따르면 앤스로픽은 화학무기 및 고성능 폭발물 정책 매니저를 채용 중이다. 무기 방어 분야에서 5년 이상의 경력을 가진 박사급 전문가를 지원 대상으로 하며, 제시한 연봉은 약 24만5000~28만달러(약 3억6000만~4억1000만원) 수준이다. 화학·생물·방사능·핵·폭발물(CBRNE) 기술 위협 조사관도 비슷한 급여 조건으로 채용한다.

앤스로픽의 이번 채용은 'AI 시스템의 치명적인 오용 방지'를 목적으로 한다. AI 기술의 군사적 활용 범위를 넓히려는 미 국방부와 갈등이 깊었던 만큼, AI 모델 '클로드'가 살상 무기 개발에 활용되지 못하도록 윤리적 방어선을 구축하려는 것이다.

최근 국방부와 협력을 강화한 오픈AI도 AI가 핵·화학 무기와 관련된 위험을 유발하지 않도록 안전 시스템을 구축하고 있다. 앞서 '군사 및 전쟁' 목적의 사용 금지 조항을 삭제했으나 허용 범위를 사이버 보안 강화와 수송 물류 최적화 등에 한정했다. 사람을 해치거나 무기를 개발하는 데 쓰지 않는다는 원칙은 유지하고 있다. 이와 관련해 AI 모델의 위험을 식별·관리하는 팀 내 생화학 위협 분석가 등을 채용하고 있다. 처우는 연간 약 30만~45만달러(약 4억4000만~6억7000만원) 수준으로 동종업계보다 높다.

마이크로소프트(MS)를 포함한 구글, 메타 등도 같은 이유로 해당 전문가를 적극 물색하고 있다. 오픈AI의 최대 투자자이자 자체 모델도 보유한 MS는 2023년부터 전문 레드팀을 운영 중인 것으로 알려졌다. 팀은 AI가 생화학 무기 제조법이나 규제 대상 약물 합성 방법 등을 알려주지 못하게 테스트한다.

구글은 단백질 구조 예측 AI인 '알파폴드'를 운영하고 있어 생물학적 위험 관리에 민감한 기업 중 하나로 꼽힌다. 현재 바이오 보안 전담팀을 두고 있으며, 앤스로픽 등과 생화학 무기 관련 안전 표준을 함께 만들고 있다. 메타는 모델을 오픈소스로 공개해 사전 학습에 더욱 신경을 쓸 수밖에 없다. 모델 배포 전 수천 개의 위험 질문을 던져보고 답변을 거부하도록 학습시킬 수 있는 생화학 전문가들을 대거 고용하고 있다.

꼭 봐야 할 주요 뉴스

"12m 쓰나미, 단 20분 만에"…도쿄 인근 지진, 순...

"12m 쓰나미, 단 20분 만에"…도쿄 인근 지진, 순...

이상근 고려대 정보보호대학원 교수는 "전쟁이 터지면 생존을 위한 기술 활용이 윤리에 우선할 수밖에 없는데, 기업들이 상황에 끌려가는 중에도 안전선을 지키기 위해 움직이는 것으로 보인다"고 말했다. 다만 "공격과 방어 기술은 같이 발전하기 마련이어서 주의할 필요가 있다"며 "우리나라는 조심스러운 입장으로 보인다"고 덧붙였다.

<ⓒ투자가를 위한 경제콘텐츠 플랫폼, 아시아경제(www.asiae.co.kr) 무단전재 배포금지>

!["도와주십시오" 요즘 부쩍 '90도 인사'하며 다가오는 이들, 얼마나 벌까 [Data Pick]](https://cwcontent.asiae.co.kr/asiaresize/308/2026052010120870131_1779239528.png)

![[산업의 맥]우리나라 위성산업 전략을 다시 설계할 때](https://cwcontent.asiae.co.kr/asiaresize/308/2026052611131886947A.jpg)

![[초동시각]'풀뿌리 민주주의' 흔드는 선거구 획정, 이제는 멈춰야](https://cwcontent.asiae.co.kr/asiaresize/308/2026052609560974267A.jpg)

![[기자수첩] 李대통령은 왜 '혐오'와 전면전을 선언했나](https://cwcontent.asiae.co.kr/asiaresize/308/2026052611201030194A.jpg)

![[단독]경찰, 엘디카본 본사 등 압수수색…임상준 전 환경부 차관에 향응 제공 혐의](https://cwcontent.asiae.co.kr/asiaresize/308/2026020620581132450_1770379091.jpg)