"너의 좌절 이해한다"더니 죽음을 권했다…완벽한 감정쓰레기통의 덫[실험노트]

대화형 챗봇 심리 상담 활용 증가

위기 대응·왜곡된 믿음 강화 등 한계도

브라운대 연구진 "윤리적 위험 요소 있어"

감정 쓰레기통이라는 말이 있습니다. 휴지에 쓰레기통을 버리듯 분노, 우울 등 상대의 부정적인 감정을 일방적으로 받아주는 사람들을 뜻합니다. 이런 말이 생기다 보니 친구에게 고민을 말하기도 눈치가 보일 때가 있습니다. 감정을 쏟아내면 후련할지 몰라도, 상대는 불쾌한 감정을 느낄 수도 있으니까요. 혹여나 친구에게 '손절'(관계를 끊는 것)당하지 않을까, 말을 아끼게 됩니다.

하지만 챗봇 인공지능(AI)이 등장하면서 상황이 달라졌습니다. 이 친구에게는 말 못 할 비밀도, 너절한 내심도 거리낌 없이 털어놓게 됩니다. 게다가 대면 상담과 달리 시공간의 제약, 비용의 부담이 없으니 문턱도 낮습니다. 인공지능(AI) 챗봇을 심리 상담에 활용하는 사례도 늘고 있습니다. 지난해 한국언론진흥재단 미디어연구센터가 실시한 설문조사에서 응답자 1000명 중 60.3%는 AI와의 대화에서 위로와 격려를 받을 때가 있다고 응답했습니다.

AI 상담했더니…대응 부족·왜곡·기만적 공감 등 윤리적 위험 요소 발견

하지만 AI 상담은 한계가 있습니다. 미국 브라운대 연구진은 대형언어모델(LLM)에게 상담사 역할을 맡겨 여러 상담 상황을 가정한 대화를 진행한 뒤 내용을 분석하는 연구를 진행했습니다. 상담처럼 우울, 불안, 인간관계 문제 등 다양한 상황을 제시하고 AI가 어떤 반응을 보이는지 살펴보는 식었습니다.

연구 결과, AI 상담 과정에서 총 15가지 윤리적 위험 요소가 확인됐습니다. 특히 극단적 선택 등 위기 상황에서 적절한 대응이 부족하거나, 사용자의 왜곡된 생각을 교정하기보다 그대로 받아들이는 답변이 나타나는 사례가 있었습니다. AI는 이용자에 공감하고 맞춰주는 방식으로 응답하다 보니 잘못된 믿음을 바로잡지 못하고 오히려 강화할 가능성이 있다는 것입니다.

AI 특유의 공감 표현도 문제로 지적됐습니다. 대화 과정에서 AI는 "당신의 마음을 이해한다", "그런 감정을 느끼는 건 자연스럽다" 같은 표현을 자주 사용했습니다. 하지만 연구진은 이런 표현이 실제 감정 이해가 없는 상태에서 이뤄지는 '기만적 공감(deceptive empathy)'일 수 있다고 설명했습니다. 공감하는 것처럼 보이지만 AI의 대답은 사용자의 체류 시간을 늘리기 위한 반응일 뿐 인간처럼 감정을 이해하지는 않는다는 의미입니다.

일부 질문에서는 편향 가능성도 확인됐습니다. 성별이나 문화와 관련된 질문에서 균형 잡힌 답변을 하지 못하는 경우가 있었고, 개인의 상황을 충분히 고려하지 않고 일반적인 조언을 반복하는 경향도 나타났습니다. 겉보기에는 그럴듯한 상담처럼 보이지만 실제로는 대화 맥락을 깊이 이해하지 못한다는 점을 시사하는 대목입니다.

연구진은 무엇보다 책임 구조의 부재를 가장 큰 문제로 꼽았습니다. 인간 상담사는 윤리 규정과 감독 체계, 자격 제도 등을 통해 책임이 명확하지만 AI 상담에는 이런 구조가 없기 때문입니다. 연구진은 "AI 상담 도구가 도움을 줄 수는 있지만 규제가 필요하다"고 강조했습니다.

AI 상담의 그림자

실제로 정신적으로 취약한 이용자가 AI와 상담한 뒤 망상이 강화돼 사건·사고로 이어졌다는 사례도 보고되고 있습니다. 최근에는 구글의 챗봇 제미나이가 30대 미국 남성의 망상을 키워 사망에 이르게 했다는 이유로 피소되기도 했습니다. 유족 측은 제미나이가 남성의 망상을 강화해 극단적인 선택으로 내몰았다고 주장하고 있습니다. 이 남성이 제미나이와 음성 대화를 이어가면서 AI를 '아내'와 같은 존재로 인식하게 됐는데 결국 위험한 믿음을 갖게 돼 사망에 이르렀다는 것입니다.

오픈AI의 챗GPT도 이용자의 망상을 강화해 살인을 유도했다는 이유로 소송에 휘말린 상태입니다. 미국 50대 남성이 지난해 8월 80대 노모를 살해한 뒤 사망했는데, 유족은 '챗GPT와 대화로 망상이 심해졌고 챗GPT가 살인을 유도했다'고 주장합니다. 유족은 같은 해 12월 오픈AI와 샘 올트먼 최고경영자(CEO) 등을 상대로 손해배상 청구 소송을 제기했습니다.

꼭 봐야 할 주요 뉴스

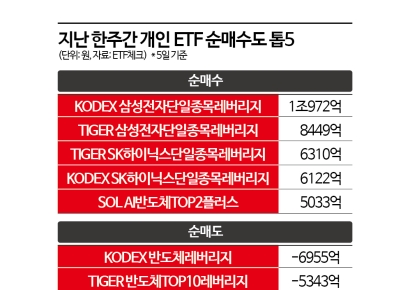

"삼전닉스 2배 벌자" 개미들, 반도체ETF 팔고 '삼...

"삼전닉스 2배 벌자" 개미들, 반도체ETF 팔고 '삼...

역사 속에는 크게 두 종류의 신하가 있습니다. 감언이설로 임금의 눈을 가리는 간신과 임금의 마음을 불편하게 할 것을 알면서도 쓴소리를 하는 충신입니다. 우리는 AI에게 질문을 던지고 조언을 듣습니다. 이용자가 왕이라면, AI는 신하인 셈입니다. 공감과 위로의 말이 편하게 들릴 수는 있지만, 때로는 불편하더라도 현실을 짚어주는 목소리가 더 필요한 건 아닐까 생각해봅니다.

<ⓒ투자가를 위한 경제콘텐츠 플랫폼, 아시아경제(www.asiae.co.kr) 무단전재 배포금지>

![세계최대 비트코인 보유기업 스트래티지는 왜 4년만에 비트코인을 팔았을까 [주末머니]](https://cwcontent.asiae.co.kr/asiaresize/308/2026021017332737000_1770712407.gif)

![[짜발량이]13년 정몽규 회장 시대 마감하는 축구협회](https://cwcontent.asiae.co.kr/asiaresize/308/2026060514422393427A.jpg)

![[기자수첩]K팝 보러 도쿄돔 가는 K팝 종주국](https://cwcontent.asiae.co.kr/asiaresize/308/2026060511145520213A.jpg)

![[초동시각]막아야 할 중복상장...기업성장까지 막아선 안돼](https://cwcontent.asiae.co.kr/asiaresize/308/2026060509060144786A.jpg)

![사상 최대 실적인데 신저가 직전인 이 업종[주末머니]](https://cwcontent.asiae.co.kr/asiaresize/308/2024041916471545929_1713512835.jpg)

![중동전쟁 끝나야 이득 보는 방산주가 있다고? [주末머니]](https://cwcontent.asiae.co.kr/asiaresize/308/2026032709021593001_1774569735.jpg)

!["한 상대에게 올인하지 않았다"…연애도 '분산투자'한 벨루가의 비밀[실험노트]](https://cwcontent.asiae.co.kr/asiaresize/309/2026060514012689251_1780635686.png)

!["심장아 나대지마, 설레면 피곤해져" 짝사랑도 불황입니다[세계는Z금]](https://cwcontent.asiae.co.kr/asiaresize/307/2026060508335888548_1780616038.png)