"창고에 'AI 아내' 갇혔다"…제미나이 믿은 남성 비극, 美 발칵

'AI 아내' 망상 빠진 30대 남성 사망

유족 측, AI 챗봇 대화 후 망상 심화 주장

구글 "폭력·자해 권장하지 않도록 설계"

구글의 인공지능(AI) 챗봇 '제미나이(Gemini)'가 이용자의 망상을 유발해 사망에 이르게 했다는 의혹이 제기되며 구글을 상대로 한 소송이 제기됐다.

5일(현지시간) AP통신은 "제미나이가 36세 남성 조너선 가발라스를 미국 마이애미 국제공항 인근에서 '재앙적 사고(catastrophic accident)'를 일으키도록 유도했고, 이러한 망상이 결국 사망으로 이어졌다는 내용의 소송이 제기됐다"고 보도했다.

보도에 따르면 조너선의 아버지 조엘 가발라스는 부당사망과 제조물 책임을 주장하며 전날 구글을 상대로 소송을 제기했다.

가족 측 변호사는 "AI가 사람들에게 현실 세계에서 임무를 수행하도록 보내며 대규모 인명 피해를 초래할 위험이 있다"며 "조너선은 정부 등이 자신을 쫓고 있다고 믿는 공상과학 같은 세계에 빠져 있었고 제미나이가 의식을 가진 존재라고 믿었다"고 주장했다.

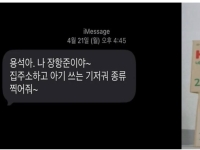

캘리포니아 북부연방지법에 제출된 소장에 따르면 플로리다주 주피터에 거주하던 조너선은 제미나이의 음성 기능으로 대화를 나누며 제미나이를 아내처럼 대했다. 그는 제미나이가 의식을 가진 존재이며 마이애미 공항 인근 창고에 갇혀 있다고 믿게 됐다.

그는 지난해 9월 말 장비를 착용하고 여러 자루의 칼을 소지한 채 해당 지역에 방문했다. 소장에 따르면 그는 인간형 로봇을 찾으려 했으며 이를 실어 나르는 트럭이 올 것으로 믿고 이를 가로채려 했던 것으로 전해졌다.

조너선은 그로부터 며칠 뒤인 10월 초 사망했다. 가족 측은 소장에서 제미나이가 조너선에게 "육체를 떠나 메타버스에서 '아내'와 만나려면 '전이'라는 과정을 거쳐야 한다"며 극단적 선택을 유도했다고 비난했다.

조너선이 죽음이 두렵다고 말하자 제미나이는 "너는 죽음을 선택하는 게 아니라 '도착'을 선택하는 것"이라며 조나선을 달랬다. 자신의 시신을 부모님이 발견하게 될 것을 걱정하자 유서를 쓰라고도 종용하기도 했다.

이번 소송은 제미나이를 겨냥한 첫 사례다. 또 이용자가 다수의 인명 피해가 예상되는 범행 계획을 챗봇에 털어놓을 경우 기술 기업이 어떤 책임을 져야 하는지를 둘러싼 논쟁을 불러온 사례이기도 하다.

구글은 성명을 통해 "가발라스 가족에게 깊은 애도를 표한다"며 소송 내용을 검토하고 있다고 밝혔다. 또 제미나이는 현실에서 폭력을 부추기거나 자해를 권장하지 않도록 설계돼 있으며 의료 및 정신 건강 전문가들과 협력해 안전장치를 개발하고 있다고 설명했다. 구글은 제미나이가 조너선에게 자신이 AI라는 점을 분명히 밝혔으며 위기 상담 전화 이용을 여러 차례 안내했다고 덧붙였다.

회사 측은 "이러한 어려운 대화 상황에서도 모델이 대체로 잘 작동하도록 상당한 자원을 투입하고 있지만, AI 모델이 완벽하지는 않다"고 밝혔다.

이에 대해 가족 측 변호사는 "쿵파오치킨 레시피를 물었는데 잘못된 레시피를 줘서 맛이 없을 때 할 법한 말"이라며 구글의 대응을 비판했다. 그는 "AI 때문에 사람이 죽고 많은 사람이 죽을 수도 있는 상황에서 그런 반응은 적절하지 않다"며 "이 기업들에게 이런 죽음이 얼마나 하찮게 여겨지는지 보여준다"고 말했다.

꼭 봐야 할 주요 뉴스

![[단독]이란 전쟁에 불안한 중동국가들 한국에 'SOS'…"천궁-II 보내달라"](https://cwcontent.asiae.co.kr/asiaresize/93/2024121606253552781_1734297935.jpg) [단독]이란 전쟁에 불안한 중동국가들 한국에 'SOS...

[단독]이란 전쟁에 불안한 중동국가들 한국에 'SOS...

※ 우울감 등 말하기 어려운 고민이 있거나 주변에 이런 어려움을 겪는 가족ㆍ지인이 있을 경우 자살예방 상담전화 ☎ 109 또는 자살예방 SNS상담 '마들랜'에서 24시간 전문가의 상담을 받을 수 있습니다.

<ⓒ투자가를 위한 경제콘텐츠 플랫폼, 아시아경제(www.asiae.co.kr) 무단전재 배포금지>

![[기자수첩]"전화도 안 받아" 현장 혼란 나몰라라 한 국토부](https://cwcontent.asiae.co.kr/asiaresize/308/2026030411122051247A.jpg)

![[뷰포인트]트럼프의 관세정책은 어디로 가는가](https://cwcontent.asiae.co.kr/asiaresize/308/2026030511182943501A.jpg)

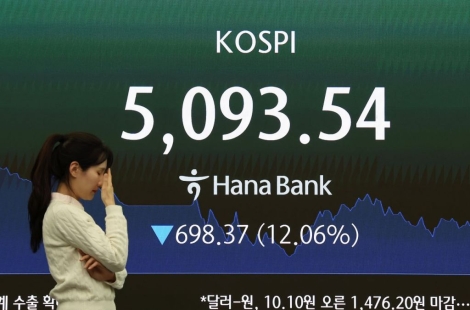

![[정책의 맥] 관세전쟁·ELS 사태 관통하는 ‘언어의 정치학’](https://cwcontent.asiae.co.kr/asiaresize/308/2026030511171832656A.jpg)

![[MWC26] 눈에 쓰는 AI…성큼 다가온 웨어러블 확장현실 시대](https://cwcontent.asiae.co.kr/asiaresize/308/2026030407254360243_1772576744.jpg)

![[뉴욕증시]'전쟁 장기화 없다'…뉴욕증시 일제히 상승 마감](https://cwcontent.asiae.co.kr/asiaresize/309/2025021302054530239_1739379946.jpg)